引言:工业智能化进程由三类核心算力载体驱动,其底层硬件架构的“物理基因”——即确定性、计算密度与物理可靠性——从根本上划定了各自的应用边界。第一类是保障逻辑与运动控制的硬实时PLC/控制器;第二类是处理非结构化数据与复杂训练任务的集中式GPU服务器;第三类则是近年来兴起的、旨在将AI推理能力原生整合到产线的工业级AI边缘计算盒子。本文旨在通过微架构层次的横向对比,剖析工业AI边缘盒子与主流架构在实时性、算力密度、I/O同步及全生命周期成本上的本质差异。

主流竞品架构的局限性:从延迟瓶颈到环境适应性

PLC+视觉控制器:逻辑确定性与算法灵活性的矛盾

传统“PLC+专用视觉控制器”架构在结构化视觉任务(如几何测量)中表现出色,其基于ASIC或DSP的固定流水线处理与硬实时总线(如EtherCAT)能实现微秒级响应。然而,面对非结构化数据(如深度学习缺陷检测),其专用硬件缺乏可编程性,内存带宽(通常)与稀疏计算能力不足,难以高效部署复杂卷积神经网络(CNN)。升级模型往往需要更换硬件,违背了工业现场的渐进式迭代逻辑。

通用机架式GPU服务器:环境依赖性与物理体积的溢出

数据中心级GPU服务器(如搭载NVIDIA A100)提供高浮点算力(TFLOPS),但其架构设计假设了稳定的温控(20-25°C)、洁净度与连续供电环境。在边缘侧部署面临三大问题:首先,其体积(如2U/4U)难以集成到设备机柜;其次,启动浪涌电流可能冲击产线电网;最后,强制风冷系统对粉尘敏感,导致MTTR(平均修复时间)因维护堵塞而升高。其软件栈(如CUDA)也缺乏与现场总线(如PROFINET)的原生低延迟交互能力。

传统工业PC(IPC):“通用CPU+离散显卡”的异构短板

传统IPC采用x86 CPU搭配PCIe插槽的消费级显卡(如NVIDIA GeForce系列)。此架构在工业环境中存在显著缺陷:第一,显卡插槽(PCIe Card Edge)在长期振动下易发生接触不良,导致信号完整性(SI)下降;第二,CPU与GPU间通过PCIe总线交换数据,引入额外延迟与CPU开销;第三,Windows或标准Linux内核并非硬实时操作系统,任务调度抖动(jitter)可达毫秒级,难以满足高速触发(如)需求;第四,在高温(>60°C)环境下,离散显卡散热系统容易引发CPU热节流,导致算力断崖式下跌。

工业AI边缘盒子的核心工程方案:从集成到融合

专用算力单元与异构内存架构

工业AI边缘盒子摒弃了“通用CPU+离散加速卡”的松散耦合模式,转而采用SoC(System-on-Chip)或核心板焊接设计,集成专用神经网络处理单元(NPU)或Tensor Core。例如,采用瑞芯微RK3588J(集成6TOPS NPU)或昇腾310(集成20 TOPS INT8)的架构,通过板载高带宽内存(如LPDDR4X)与NPU的直接连接,实现更低延迟的权重数据访问。与x86指令集执行通用任务相比,NPU针对INT8/FP16量化、算子融合及激活函数(如ReLU)进行硬化,能将能效比(TOPS/W)提升5-10倍。

硬件级触发与确定性时序闭环

通用服务器依赖软件轮询或网络事件(如GigE Vision的Packet Resend)进行图像采集,响应延迟在毫秒级且存在抖动。工业AI盒子则通过板载FPGA或专用MCU(如ARM Cortex-M)实现硬件级同步:外部传感器信号经光耦隔离后,直接触发FPGA内部的状态机,进而同步控制工业相机曝光、光源频闪,并在推理完成后通过同一FPGA的硬件计时器输出结果至PLC。此闭环路径的延迟可稳定在微秒级(如),符合IEC 61131-3中对“确定性响应”的要求。

计算层与安全控制层的物理解耦

为保障现场安全,高端工业AI盒子采用物理隔离设计:NPU/GPU所在“AI计算层”运行在非实时Linux或专用RTOS(如VxWorks)上,负责视觉推理;独立的“安全逻辑处理层”(可能基于Cortex-R或小型PLC核心)则通过硬连线连接急停(E-Stop)、安全门等安全回路。即使AI计算层因算法异常或系统更新而重启,安全控制层仍可保持运行,确保产线处于安全状态。

持久化工程:从内存到存储的可靠性设计

工业环境存在强电磁干扰(EMI)与突发掉电风险。工业AI盒子采用带有ECC的LPDDR内存,可纠正单位元错误,防止因粒子辐射或电磁噪声导致的位翻转(bit-flip)。存储方面,采用工业级eMMC或SSD,并支持pSLC(pseudo-SLC)模式,通过将TLC/QLC闪存单元模拟为SLC使用,牺牲部分容量换取更高的P/E周期(通常提升3-5倍)与数据保持力,以适应频繁写入日志的工况。

协议栈原生集成与网关延迟消除

传统方案中,视觉系统需通过独立网关(如PROFINET转Ethernet)与PLC通信,增加延迟与故障点。工业AI盒子通过集成协议硬核(如TI Sitara系列处理器的PRU-ICSS)或软件协议栈(如SOEM for EtherCAT),直接在应用层输出结构化结果至现场总线。例如,通过EtherCAT的分布式时钟(DC)机制,可将推理结果嵌入到精确的通信周期中(通常为1ms),实现与运动控制的亚毫秒级同步。

行业验证:基于架构差异的效能与TCO对比

高速缺陷检测线:触发精度与漏检率

场景:包装材料表面瑕疵检测,线速度5m/s,相机分辨率2000万像素。对比”PLC+硬触发AI盒子”与“服务器+软件触发”方案。前者通过FPGA实现行触发,曝光与传输误差,漏检率(基于连续100万样本);后者因网络协议栈抖动(典型值±500μs),导致图像采集与运动位置失步,漏检率升至0.1%以上,且需额外投入高精度编码器与时间戳服务器以校正时序。

移动机器人(AMR/AGV):功耗、体积与抗冲击性

场景:仓库AMR的视觉导航与避障。对比“嵌入式AI盒子(如NVIDIA Jetson AGX Orin,功耗10-30W)”与“车载工控机+mini-ITX显卡(总功耗70-150W)”。在同等算力(约200 TOPS INT8)下,嵌入式方案体积减少60%,功耗降低3-5倍,且采用无连接器的核心板设计,通过振动测试(如IEC 60068-2-64)的加速度阈值提高2倍以上。三年TCO分析显示,嵌入式方案因功耗降低与维修率下降,总持有成本减少约40%。

恶劣环境部署:温度应力与MTTR

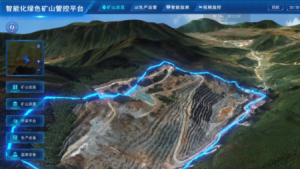

场景:露天矿山输送带异物检测。环境温度范围-30°C至+55°C,粉尘浓度高。对比“无风扇全密闭AI盒子(宽温-40°C~+85°C)”与“带风扇加固IPC”。前者采用传导散热与密封设计,两年内因粉尘导致的故障率为0;后者需每季度清洁风扇与散热片,因热节流导致的意外停机每年约3次,MTTR增加8小时/次。基于Telcordia SR-332标准计算,前者的MTBF(平均无故障时间)预计超过10万小时,后者约为6万小时。

选型指南与结论

工业AI边缘盒子的选型决策应基于四象限分析:算力需求(INT8/FP16 TOPS)、延迟确定性(μs级硬触发 vs. ms级软件触发)、物理约束(体积、功耗、安装方式)及环境应力(温度、振动、EMC)。结论表明,对于需要微秒级触发同步、高抗振性及宽温运行的OT层感知任务,基于SoC/NPU、硬件触发与工业级持久化设计的专用AI盒子是实现“原生智能”的最短路径。其硬件架构的物理特性——从焊接式核心板到ECC内存——决定了其在严苛工业环境下的可靠性与全生命周期成本优势。

工业级AI视觉边缘计算盒子

该硬件是一款部署在网络边缘侧(靠近摄像头端)的高性能智能终端。就像给普通摄像头装上了“超级大脑”,能在本地实时处理海量视频数据,无需全部上传云端。该设备具备高算力、接口丰富、系统开放等特点,广泛应用于工厂、园区、工地等场景,实现对人、车、物、事的24小时全自动智能监管。

声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:sales@idmakers.cn删除,任何个人或组织,需要转载可以自行与原作者联系。