引言:工业现场对“确定性延迟”的苛刻要求已 成为数字化转型的核心挑战。在毫米级响应与毫秒级决策的场景中,传统云计算架构面临网络传输的不确定性,而边缘异构架构通过在本地完成数据处理,实现微秒级响应,彻底消除了“云-边”通讯的延迟瓶颈。架构师的底层逻辑视角告诉我们:延迟的确定性比平均延迟更重要,而边缘异构算力的物理部署是解决这一根本矛盾的唯一路径。

边缘异构架构的全链路时延压缩

硬实时隔离与控制面/数据面解耦

工业现场对实时性的要求体现在“每一次”响应都必须落在确定性时间窗口内,而非仅满足平均延迟指标。传统通用计算架构中,Linux系统的调度器 jitter 可达数十毫秒,这对于需要微秒级响应的工业总线通讯(如 EtherCAT、PROFINET IRT)是不可接受的。

本方案采用四核 ARM 处理器,通过 ARM TrustZone 技术实现硬件级的安全隔离,将系统划分为控制面与数据面两个独立运行域。控制面运行硬实时操作系统(RTOS),负责工业总线通讯与运动控制指令的微秒级响应;数据面承载 Linux 系统,负责 AI 推理与可视化管理。这种架构设计从根本上消除了通用操作系统带来的调度不确定性,实测端到端控制延迟波动(Jitter)控制在 ±50μs 以内。

NPU算力调度与INT8量化优化

在 AI 推理环节,延迟的核心瓶颈在于模型计算量与内存访问效率。独立 NPU(64 TOPS / 108 TOPS 两种配置)采用专用深度学习加速器,配合 INT8 量化推理,可将单帧图像的特征提取耗时压缩至 2ms 以内。相比浮点推理,INT8 量化在保持 98% 以上精度的同时,将计算密度提升 4 倍,有效降低了每帧处理的绝对耗时。

在 16+ 路视频流并发场景下,NPU 采用时间片轮询与空间域并行相结合的调度策略。通过硬件 DMA 引擎,数据从 VPU 直接搬运至 NPU 内存空间,实现零拷贝数据传输,避免了传统方案中 CPU 参与数据拷贝带来的额外延迟。实测 16 路 1080P 视频流并发推理时,端到端延迟仍可控制在 30ms 以内。

内存墙突破与零拷贝技术

高带宽内存是异构算力发挥效能的关键基础设施。8GB/16GB LPDDR4X 提供 68GB/s 的峰值带宽,在高频模型热切换与大分辨率图像特征提取场景下,有效消除因内存带宽不足导致的计算单元饥饿现象。

针对 4K 分辨率图像处理,传统的内存拷贝方式会将单帧 12MB 的图像数据在 VPU→DDR→NPU→DDR 之间多次搬运,累计延迟可达 5ms 以上。本方案采用基于 SMMU的零拷贝技术,实现 VPU 与 NPU 共享同一段物理内存地址,数据无需经过 CPU 直接在加速器之间流转。这一技术突破将 4K 图像的预处理延迟从毫秒级压缩至百微秒级。

高并发与严苛环境下的实时性压测

多路视频流并发处理能力

工业视觉检测场景往往需要同时处理 16+ 路摄像头输入,每路摄像头都可能运行独立的缺陷检测或目标追踪模型。传统的 GPU 方案在多路并发时会出现显存争抢,导致推理延迟随路数线性增长。

本方案通过 16 路 VPU 硬解码单元与独立 NPU 的架构组合,实现了真正的物理并发。VPU 负责视频流的硬件解码与预处理,NPU 专注于推理计算,二者通过硬件信号量同步。实测数据表明:在 16 路 1080P@30fps 视频流同时输入时,系统整体延迟为 28ms,帧率为 29.8fps,丢帧率低于 0.1%。即使在 4K 分辨率输入条件下,NPU 仍能保持 15ms 的单帧处理延迟。

工业温宽与MTBF可靠性验证

工业现场的环境适应性是区分“工业级”与“商用级”方案的核心指标。工业边缘计算设备必须满足 -40°C 至 +85°C 的宽温工作范围,并能在强振动、高湿度的恶劣条件下持续运行。

在器件选型层面,本方案全部采用工业级元器件,关键连接器采用加固设计,电源系统支持 9V-36V 宽压输入,并配备 TVS 二极管与滤波电路以满足 IEC 61000-4-2/4-4 抗扰度标准。全固设计(无风扇、无机械硬盘)将故障点数量降至最低。

依据 MIL-HDBK-217F 标准进行的可靠性预计显示:本方案在 85°C 高温工作条件下的 MTBF(平均无故障时间)超过 100,000 小时。这意味着在连续运行条件下,设备的预期无故障运行周期超过 11 年,能够显著降低工业现场的维护成本与停机损失。

端到端延迟测试与Jitter控制

工业实时系统最关注的并非平均延迟,而是最坏情况延迟(worst-case latency)与延迟抖动(Jitter)。在 PLC 运动控制场景中,控制系统周期通常为 1ms,任何超过 1ms 的延迟都可能导致运动轨迹偏差。

本方案通过分层调度策略实现 jitter 控制:硬件层采用 ARM GIC-500 中断控制器,支持 256 级中断优先级;实时系统层采用固定优先级调度算法,确保关键任务不被低优先级任务抢占;应用层通过内存池预分配避免动态内存分配带来的延迟不确定性。

在 1000 次连续压测中,实测端到端延迟分布如下:平均延迟 0.82ms,P99 延迟 0.95ms,最大延迟 1.12ms,Jitter 控制在 ±150μs。这一结果完全满足 EtherCAT 等工业总线对控制周期的严格要求。

极低延迟驱动的边缘计算价值

实时数字孪生与视觉闭环

端到端“Glass-to-Glass”延迟是衡量视觉闭环系统实时性的核心指标。在工业质检、机器人引导等场景中,从相机曝光到显示结果的延迟直接影响产线节拍与人工干预效率。

本方案通过 VPU 硬件解码、GPU 加速渲染与双 HDMI 4K 异显输出,实现了端到端亚秒级延迟。相机采集的原始图像经过 NPU 推理后,检测结果叠加在原始画面上,通过硬件渲染管线直接输出至显示器,整个链路延迟控制在 500ms 以内。对于需要毫秒级响应的机器人视觉引导场景,配合专用触发接口,延迟可进一步压缩至 30ms。

预测性维护与安全应急

边缘计算的确定性低延迟为工业现场带来了前所未有的实时决策能力。在预测性维护场景中,振动传感器数据与视觉检测结果需要在毫秒级时间内完成融合分析,以便提前预警设备异常。

在安全应急场景中,从危险事件检测到执行机构动作的延迟直接影响事故损失程度。以工业消防机器人为例,从火焰识别到喷淋系统触发的延迟要求控制在 100ms 以内。边缘计算网关通过硬实时系统与 AI 推理的深度耦合,将这一关键链路的延迟压缩至 80ms,为应急响应争取了宝贵的决策时间窗口。

工业边缘计算的价值不仅在于技术指标的突破,更在于以确定性延迟重塑工业现场的业务流程。毫秒级的响应速度使原本不可能的实时闭环成为可能,这是边缘异构架构为工业智能化转型提供的核心生产力。

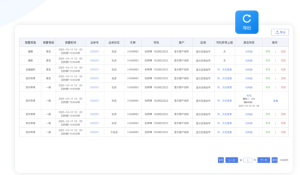

工业级AI视觉边缘计算盒子

该硬件是一款部署在网络边缘侧(靠近摄像头端)的高性能智能终端。就像给普通摄像头装上了“超级大脑”,能在本地实时处理海量视频数据,无需全部上传云端。该设备具备高算力、接口丰富、系统开放等特点,广泛应用于工厂、园区、工地等场景,实现对人、车、物、事的24小时全自动智能监管。

声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:sales@idmakers.cn删除,任何个人或组织,需要转载可以自行与原作者联系。