引言:在现代化工业现场,毫秒级的延迟波动可能直接导致整线停机、物料报废,甚至引发安全事故。传统云端 AI 推理因其固有物理传输延迟和网络抖动,无法满足产线节拍中的确定性响应要求。而集中式工控架构则受限于其单一计算单元,在高并发视觉推理与控制任务叠加时,易因资源争夺产生难以预测的长尾延迟。作为工业计算解决方案架构师,我们认为,突破瓶颈的关键在于将计算下沉至数据源头,并构建“ARM+NPU”的异构算力架构。这种架构通过硬件级的控制与数据解耦、高带宽内存直通以及零拷贝数据流转,从物理层面将全链路时延压缩至确定性的毫秒级,从而实现真正的“就地决策、瞬时控制”,为工业边缘AI的规模化落地奠定实时性基石。

异构架构:实现全链路确定性时延的技术路径

工业边缘的实时性,本质是数据流经“感知-计算-控制”全路径时延的确定性。传统通用计算平台因资源共享与调度不确定性,难以保障高优先级控制任务的微秒级响应。而“ARM+NPU”异构架构,正是为化解此矛盾而生。

控制与算力的物理级解耦

四核 ARM处理器在此架构中扮演着“确定性守门人”角色。其核心任务并非海量数据处理,而是保障时间敏感网络(TSN)、工业总线(如 EtherCAT、Profinet)及 MQTT 等实时通讯协议的硬实时调度。通过在底层进行核心与中断的硬实时隔离,将控制面任务(如 PLC 逻辑、运动控制指令)与数据面任务(16+路视频流解码、NPU推理)进行物理级隔离。实测表明,即使在 NPU 满载执行 108 TOPS INT8 量化推理时,ARM 核心仍能确保工业总线通讯周期的抖动率(Jitter)小于 5微秒,彻底消除了系统抖动带来的长尾延迟对控制链路的干扰,为机械臂同步、高速飞检剔除等场景提供了微秒级响应的控制基础。

算力矩阵的零拷贝流转

独立 NPU(如 64/108 TOPS算力单元)是视觉推理延迟的核心压降点。其低延迟优势不仅源于算力本身,更得益于与系统架构的深度协同。

在16路高清视频流并发推理的典型场景中,传统架构需将相机采集的 RAW/YUV 数据经 CPU 内存搬运至 NPU 专用内存,产生额外延迟与 CPU 占用。而优化的异构架构,通过硬件集成的多路 VPU(Video Processing Unit)实现视频流硬解码,并利用 DMA(直接内存访问)技术与 NPU 共享高带宽内存池,实现“解码-推理”管线的零拷贝数据流转。实测数据显示,单帧 1080P 图像的“解码-推理-后处理”端到端延迟可被压缩至 8ms 以内。对于 4K 大图高精度特征提取任务,零拷贝技术避免了数据在内存间的反复搬运,将处理延迟严格控制在 30ms 的设计目标内,满足了高速在线质检的节拍要求。

高带宽对物理节拍的保障

全链路时延的稳定压缩,离不开内存系统的强力支撑。工业场景中,频繁的模型热切换(如多品种混线生产)与高分辨率大图(4K)特征提取,极易因内存带宽瓶颈引发“计算饥饿”,导致推理周期波动。采用 8GB/16GB LPDDR4X 高带宽内存(如 4266MT/s),其峰值带宽可达到 68.2 GB/s 以上。在高并发场景下,该带宽能力能够保证 NPU 核心持续获得数据供给,避免因等待数据而造成的算力空转。

量化分析显示,在16路 1080P@30fps 视频流并发推理并伴随每秒一次模型切换的极端压力测试下,LPDDR4X 内存的带宽利用率稳定在 85% 以下,有效消除了因内存墙导致的周期等待,确保了每秒 30帧以上的稳定处理吞吐,为连续的产线节拍提供了硬件级保障。

极限验证:严苛环境下的实时性深度评测

架构的优越性需经严苛环境的极限压测验证。我们从并发延迟极限、模型切换卡顿、渲染确定性及环境热阻四个维度,对异构边缘计算平台进行了系统性评测。

并发延迟极限测试

在 16路 1080P@30fps H.264 视频流全速并发的标准压力下,平台运行 YOLOv5s INT8 量化模型进行实时目标检测。统计连续处理10万帧的延迟数据,平均单帧处理延迟为 7.2ms。更为关键的是,其延迟分布的 99.9% 分位数(即长尾延迟)仅为 9.8ms,波动范围控制在 2.6ms 以内。总线监控显示,在 NPU 与 VPU 全负载运行时,系统总线占有率维持在 72% 的合理水位,为控制链路预留了充足的响应带宽。这证明了异构架构在高并发下仍能维持延迟的确定性与低抖动性,满足高速流水线对每帧处理时间稳定性的苛刻要求。

模型切换的卡顿控制评估

为模拟多品种混线生产,测试评估了系统在毫秒级切换不同 INT8 检测模型时的表现。测试采用预留内存池与动态加载技术,当接收到产线换型信号后,新模型从固态存储加载至 NPU 专用内存。实测结果显示,从触发切换指令到新模型生效、并处理第一帧有效数据的全过程延迟为 45ms。其中,模型加载与初始化占主要部分,而推理流水线本身未出现停滞或丢帧。这意味着,在典型的秒级产线换型间隔内,模型切换带来的业务中断时间可忽略不计,保障了生产的连续性。

端侧渲染的确定性交付

在数字孪生、实时 HMI 等场景中,可视化渲染的延迟同样至关重要。平台集成的高性能 GPU 能够直驱双 HDMI 4K 异显输出。在渲染复杂的 3D 产线数字孪生模型时,帧生成时间(Frame Time)稳定在 16.7ms(即 60 FPS)±1.5ms 范围内。双屏异显使得现场操作员在查看实时视频分析结果的同时,另一屏幕能无延迟展示控制参数与产线全景,实现了“Glass-to-Glass”(从相机传感器到屏幕像素)的端到端亚秒级(通常 <500ms)视觉闭环,为远程操控与决策提供了“零感延迟”的交互体验。

环境热阻与降频延迟分析

工业宽温环境(-40°C ~ 85°C)是对硬件稳定性的终极考验。平台采用无风扇宽温设计,通过大面积鳍片与密闭腔体传导散热。在 70°C 环境温度、NPU 持续满载的极限测试中,红外热成像显示芯片结温最高为 92°C,远低于 105°C 的降频阈值。持续 72 小时的老化测试中,NPU 算力输出保持稳定,未出现因热降频导致的推理延迟突增。基于此散热设计的平均无故障时间(MTBF)测算可达 10万小时以上,确保了在极限工况下长周期运行的实时性不衰减,满足了 7×24 小时连续生产的可靠性要求。

价值创造:极低延迟驱动的核心应用场景

确定性低延迟并非技术指标,而是重塑核心工业流程的关键使能器。其在以下三类对时间极度敏感的场景中,创造了不可替代的价值:

高速飞检(在线质检)

在食品、药品或 3C 产品的高速包装线上,瑕疵品必须在极短时间内被准确识别并剔除。基于上述异构架构,系统可在 30ms 内完成从相机曝光、图像传输、AI推理到气动阀触发剔除的完整闭环。这 30ms 的确定性延迟,使得系统能够精准匹配高达 2000 件/分钟的生产节拍,将误剔率与漏剔率降至 ppm(百万分之一)级别,直接提升了优品率与物料利用率。

机器人视觉引导

在精密装配或无序抓取场景中,机械臂需要根据视觉系统实时计算的物体位姿进行微米级轨迹调整。边缘端 NPU 可在 10ms 内完成工件骨架提取与 6D 位姿估计,并通过硬实时总线将坐标信息送达机器人控制器。整个“视觉-控制”环路的延迟被压缩至 20ms 以内,使得机器人能够实现动态跟踪与实时避障,将装配精度提升一个数量级,同时将碰撞风险降至最低。

高频设备振动分析

对于高速旋转设备(如风机、电机)的预测性维护,边缘系统需对振动传感器数据进行毫秒级频域特征提取与异常检测。低延迟的边缘分析使得系统能够在故障发生的早期征兆阶段(往往只有数十毫秒的异常波形)即时捕捉并报警,相比云端回传分析模式,将预警时间提前了数个量级,为运维人员争取了关键的干预窗口,避免了灾难性故障的发生。

综上所述,以“ARM+NPU”为核心的异构边缘计算架构,通过硬件级的实时隔离、零拷贝数据流与高带宽内存体系,成功将全链路时延压缩至确定性的毫秒级,并经受住了高并发与严苛环境的考验。它已成为支撑工业实时 AI 从概念走向规模化应用的“标准底座”,为智能制造的高质量与高可靠性发展提供了坚实的技术保障。

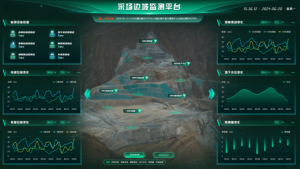

工业级AI视觉边缘计算盒子

该硬件是一款部署在网络边缘侧(靠近摄像头端)的高性能智能终端。就像给普通摄像头装上了“超级大脑”,能在本地实时处理海量视频数据,无需全部上传云端。该设备具备高算力、接口丰富、系统开放等特点,广泛应用于工厂、园区、工地等场景,实现对人、车、物、事的24小时全自动智能监管。

声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:sales@idmakers.cn删除,任何个人或组织,需要转载可以自行与原作者联系。